Rapport de progrès sur l'IA de Biden : six mois après

Table des matières:

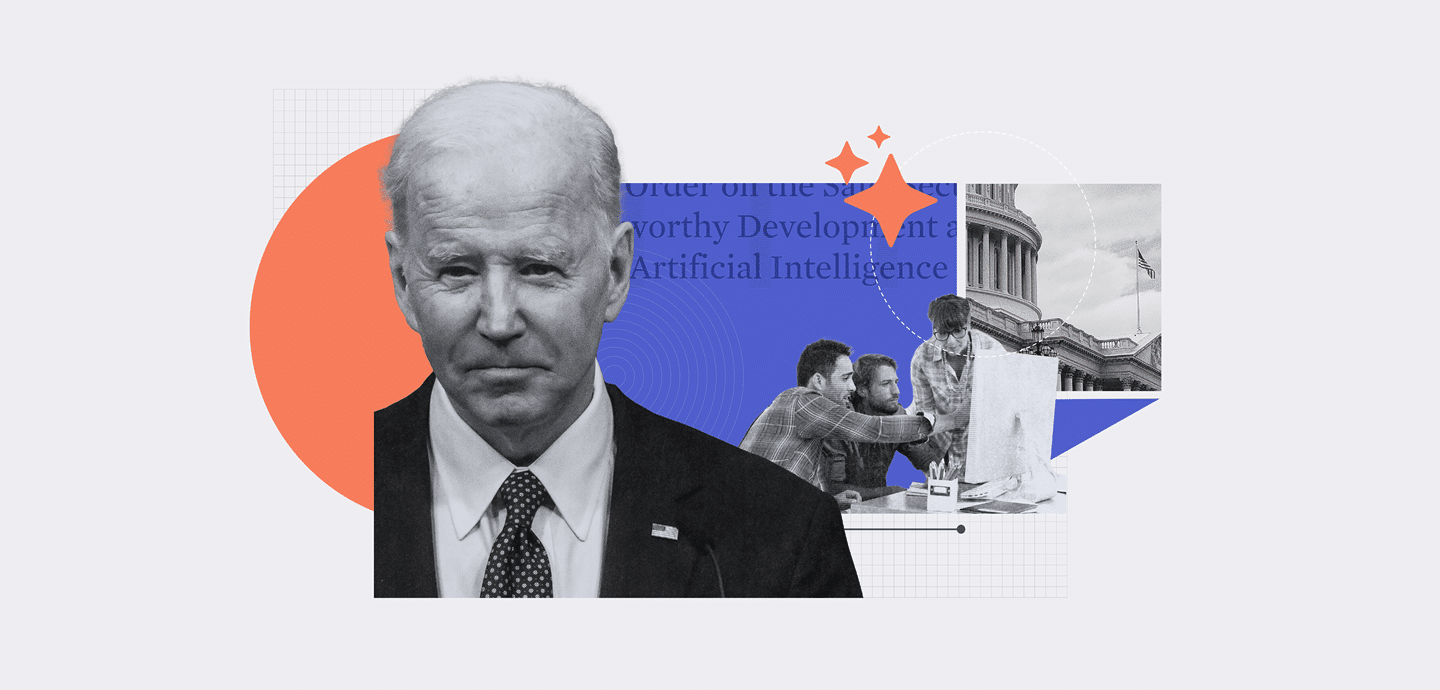

Cela fait six mois que le gouvernement américain a adopté un décret d’une grande portée visant à répondre à la nécessité d’une IA responsable. Le Décret sur une intelligence artificielle sûre, sécurisée et digne de confiance a répondu aux préoccupations concernant la sécurité et la sûreté de l'IA, ainsi que ses effets sur les libertés civiles et les droits des travailleurs. Il a également reconnu la nécessité d'augmenter considérablement les compétences du personnel fédéral en matière d'IA. Ces préoccupations se sont traduites par un large éventail d’actions dans toutes les agences fédérales. Six mois plus tard, comment se déroule sa mise en œuvre ?

Action coordonnée

L’EO était coordonné avec les activités de l’ensemble du pouvoir exécutif. Les semaines qui ont suivi annonce Le 30 octobre 2023 a été marqué par une vague d'activités au sein de diverses agences, comme l'annonce par le Département d'État de sa stratégie d'IA d'entreprise le 9 novembre.

Le ministère de la Défense avait également clairement prévu sa réponse. Presque immédiatement après la publication de l'EO, le DoD libéré sa stratégie d’adoption des données, de l’analyse et de l’intelligence artificielle pour 2023, qui a remplacé sa stratégie d’IA de 2018. Cette politique est particulièrement importante pour le Pentagone qui, selon une institution de la Brookings rapport représente la part du lion des contrats fédéraux en matière d’IA du gouvernement américain. Les dépenses liées aux contrats d’IA militaire représentaient 557 millions de dollars sur les 675 millions de dollars engagés dans les contrats d’IA dans toutes les agences au cours de l’année jusqu’en août 2023, selon le rapport.

Un bulletin solide

Le 28 mars, la Maison Blanche rapporté que les agences avaient respecté tous les délais de 90 et 150 jours prévus par l'EO. Les mesures détaillées dans ce analyse chronologique comprenait la production d’un rapport du Département du Trésor sur la gestion des risques liés à l’IA dans les services financiers, ainsi qu’une auto-évaluation par chaque agence des risques que l’IA fait peser sur les infrastructures nationales critiques.

Diverses agences ont contribué aux efforts de sécurité de l’IA. Le ministère du Commerce a créé le 1er novembre l'Institut américain de sécurité de l'IA au sein du National Institute for Standards and Technology (NIST), et a depuis affecté du personnel et créé un consortium pour soutenir l’organisation. À la mi-avril, la NSA a publié ses orientations sur le déploiement sécurisé des systèmes d’IA.

Le Comité consultatif national sur l'IA (NAIC) s'est penché sur les questions de sécurité de l'IA, recommander l’introduction d’un système de notification des événements indésirables à partir des systèmes d’IA. La recommandation NAIC utiliserait potentiellement les définitions de l'Office of Management and Budget (OMB) de l'IA ayant un impact sur la sécurité et les droits comme cadre. Celles-ci ont été exposées dans le rapport de la CAMO du 28 mars. mémorandum sur le renforcement de la gouvernance, de l'innovation et de la gestion des risques pour l'utilisation de l'intelligence artificielle par les agences, qui a consolidé bon nombre des mandats définis pour les agences gouvernementales exécutives dans l'EO.

Les pratiques de sûreté et de sécurité énoncées dans le mémorandum de l'OMB comprenaient un ensemble de pratiques minimales pour l'IA ayant un impact sur les droits, ainsi que l'exigence que les agences commencent à les suivre d'ici le 1er décembre 2024. Si elles ne peuvent pas suivre ces directives, elles doivent alors cesser d'utiliser l'IA en question. .

D'autres domaines de progrès basés sur les demandes de l'EO incluent la conception et la mise en œuvre de plans visant à recruter davantage de talents en IA au sein du gouvernement américain. La NAIC a formulé plusieurs recommandations au quatrième trimestre 4. Elle a appelé à améliorer les connaissances en IA parmi les Américains, et a également recommandé un faire la promotion de réussite professionnelle tout au long de la vie en IA. La Maison Blanche a donné suite à un appel à talents en IA lors d'une campagne d'embauche en janvier.

Les progrès se sont étendus à la gouvernance internationale. Le Département d'État annoncé en novembre, 47 États avaient approuvé la Déclaration politique sur l’utilisation militaire responsable de l’intelligence artificielle et de l’autonomie, une initiative lancée à La Haye en février 2023.

La loi sur la production de défense : une question tendue

Les EO affectent généralement le secteur privé soit par leur impact sur les entrepreneurs fédéraux, soit par les instructions données aux agences qui appliquent des règles spécifiques. Parfois, cependant, la Maison Blanche invoque des pouvoirs spéciaux. Dans ce cas, il a utilisé la loi sur la production de défense pour réglementer les modèles d’IA à double usage.

En vertu de cette législation de 1950, le président peut obliger les entreprises du secteur privé à suivre des règles de production données. Dans ce cas, les producteurs d’IA doivent rendre compte de leurs tests de sécurité de l’IA ainsi que de l’utilisation de la puissance de calcul au-dessus d’un seuil donné. Les fournisseurs de capacités de calcul doivent également signaler l’utilisation par certaines puissances étrangères de leurs capacités pour la formation à l’IA.

NetChoice, une association professionnelle d'entreprises technologiques qui compte parmi ses membres Google, Meta et Amazon, estime que le gouvernement outrepasse sa réglementation de grande envergure. Carl Szabo, l'avocat général de l'organisation, affirme que les réglementations, y compris le recours au DPA tel que décrit dans l'EO, auront un effet dissuasif sur les investissements du secteur privé.

"Lorsque vous commencez à ajouter des limitations réglementaires et des contrôles réglementaires qui doivent être effectués avant de pouvoir déployer un système d'intelligence artificielle, cela va limiter ma capacité en tant qu'investisseur à commercialiser un produit et à obtenir le retour sur investissement nécessaire", " il a dit.

Il estime également que la portée de l'EO est si vaste qu'elle pourrait être contestée devant les tribunaux.

"Je ne peux pas vous dire quand cela va se produire, mais je peux dire qu'il y a certainement des discussions entre de nombreuses personnes que j'ai entendues sur la possibilité de lancer un défi", a-t-il ajouté.

Dans le même temps, le gouvernement maintient sa promesse de lutter contre les risques liés à l’IA et à son utilisation responsable, après une croissance de près de 260 % de ses engagements financiers dans les contrats d’IA au cours de l’année jusqu’en août 2023.

Les entreprises qui envisagent d’utiliser l’IA, en particulier celles qui pourraient être affectées par des contrats avec le gouvernement américain, feraient bien de suivre les normes émergentes en matière d’utilisation responsable. Le NIST a publié le Cadre de gestion des risques liés à l'IA, tandis que le récemment publié ISO / IEC 42001 la norme pour le déploiement et la maintenance des systèmes d’IA est un autre cadre utile à suivre. Avec le passage du Loi sur l'IA de l'UE en mars, la nécessité de démontrer les meilleures pratiques lors de la mise en œuvre de l’IA est plus aiguë que jamais.